L’IUIS, Institut Universitaire d’Ingénierie en Santé, coordonne le programme Autonomie, programme de recherche pluridisciplinaire ayant pour objet d’identifier des problématiques dans le domaine, trouver des projets et des financements.

Ce programme a présenté à Planète ROBOTS quelques-uns de ses travaux en cours.

Neurosciences de l’interaction sociale : hyperscanning et avatars virtuels

Guillaume Dumas est chercheur en neuroscience à l’institut Pasteur, au laboratoire de Génétique Humaine et Fonctions Cognitives. Les travaux présentés reposent sur le constat que la cognition sociale se construit dynamiquement à partir de nos interactions avec les autres.

Une fois cela dit, comment en rendre compte scientifiquement ?

La technique de l’hyperscanning EEG

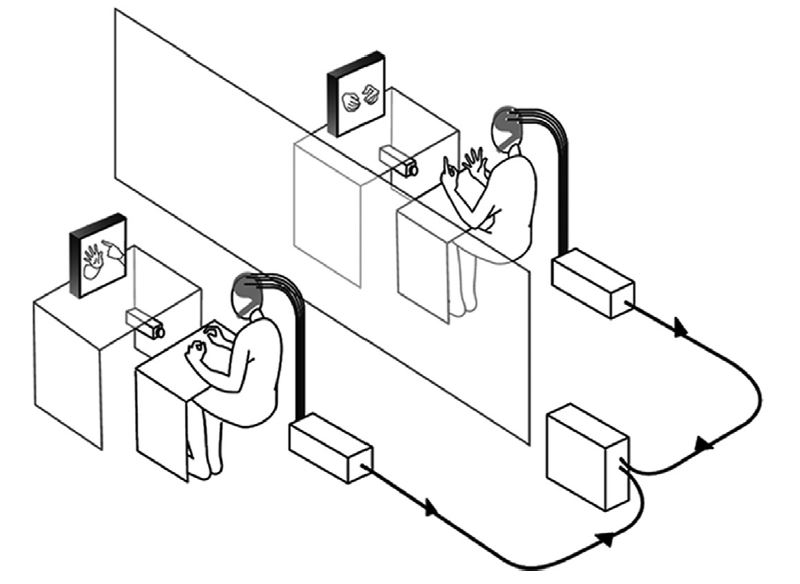

Une solution consiste à enregistrer l’activité cérébrale de plusieurs personnes en interaction. Ce type d’expérience a déjà été réalisée avec des IRM (Imagerie par Résonance Magnétique). Chaque personne enregistrée est placé dans un caisson IRM et un serveur synchronise les signaux recueillis.

Les résultats sont saisissants : lors du visionnage d’un film, les points de synchronisation entre les cerveaux sont les scènes les plus sociales, où apparaissent un visage, une expression.

La technique de l’EEG (ElectroEncephaloGraphie) est moins précise spatialement, mais plus précise temporellement, et surtout beaucoup plus légère et abordable.

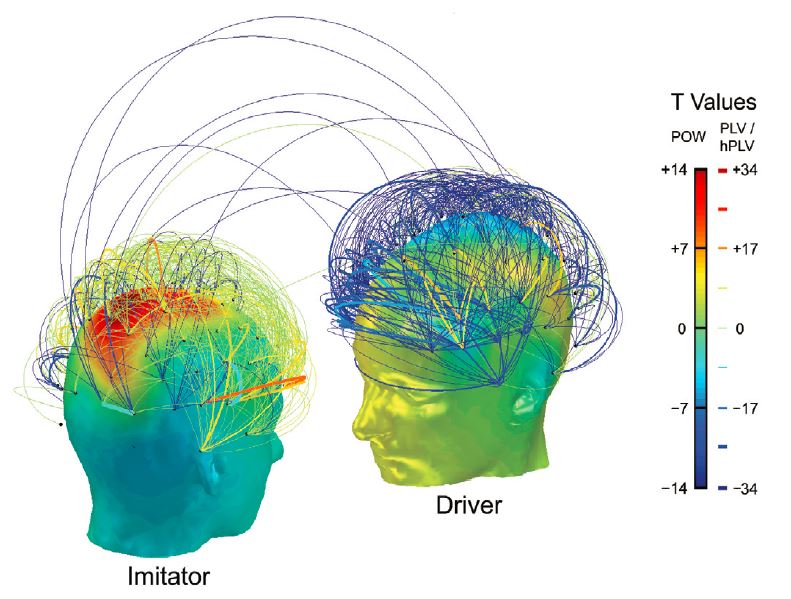

De plus, la reconstruction de sources en recombinant avec une IRM anatomique permet de pallier au manque de précision spatiale.

Cette technique utilisée dans une expérience d’imitation spontanée permet de voir la synchronisation en phase des ondes cérébrales entre les cerveaux des deux interlocuteurs. Certaines en symétrie, seraient très impliquées dans la perception relationnelle.

Adaptée à des personnes atteintes d’autisme, ces recherches remettent en cause l’hypothèse qui prévalait jusqu’ici d’un dysfonctionnement des neurones miroirs, pour plutôt mettre en évidence des altérations des capacités sensori-motrices.

Le chercheur analyse également les comportements des personnes placées face à un avatar dans le cadre du projet Human Dynamic Clamp. L’humain y est alors couplé, non pas avec un autre humain mais avec un modèle mathématique en temps réel qui prend la forme d’un jeu vidéo.

Les signaux des interactions sociales

Mohamed Chetouani étudie des signaux, mais d’un genre tout à fait particulier, puisqu’il s’agit de signaux sociaux.

Il s’est particulièrement penché sur la synchronie, c’est-à-dire l’adaptation dynamique et réciproque des comportements et états émotionnels des partenaires en interaction. On retrouve ce phénomène avec les bancs de poissons qui nagent ensemble ou lorsque le pas de deux personnes marchant côte à côte fini par s’accorder.

Que permet de déceler ce phénomène ?

Actuellement, l’autisme est décelé après 24 mois. Une équipe de l’université de Pise a demandé à des familles de leur fournir des films familiaux dans lesquels se trouvent des bébés. Ces images ont été analysées par des cliniciens des interactions sociales à la recherche de synchronie entre parents et enfants. L’idée est de comparer la « signature sociale » entre des enfants développant des troubles autistiques et ceux n’en développant pas.

Le travail réalisé a pu démontrer l’importance du babillage de la mère vers l’enfant : celui-ci était un marqueur important. Par ailleurs, il favorise l’interaction sociale comme l’ont montré les taux de réponse dans les films.

Avec l’utilisation massive des smartphones, ce type d’analyse pourra se généraliser et s’automatiser au point que les images que nous laisserons dans les réseaux sociaux pourront témoigner des liens qui nous unissent.

Une étude israélienne a quant à elle mise en évidence la synchronisation du taux d’ocytocine chez l’enfant en interaction avec son père, dont on avait fait varier artificiellement le taux de cette hormone.

Cela a conduit l’Institut des Systèmes Intelligents et Robotiques (ISIR) a réaliser une modélisation en terme d’étude comportementale, qui a montré l’importance du rôle du mouvement du corps dans la libération de l’ocytocine. Cette donnée est importante en termes de risque chez les pratiques des cliniciens, de plus en plus limitées dans le temps. Il faut donc que le praticien dispose du temps nécessaire à sa pratique pour se synchroniser avec le patient.

Les chercheurs de l’ISIR ont repris ces modèles dans des situations cliniques. Dans l’expérience, une mère et son enfant sont assis perpendiculairement. Leurs mouvements sont mesurés avec des kinects pour en réaliser une modélisation 3D. Ce protocole permet des mesures des engagements en face à face, des engagements par réalisation de tâches et des synchronies.

L’équipe travaille également à de la robotique comportementale. Un Nao est utilisé lors d’expériences de robotique d’imitation dans lesquelles l’enfant enseigne au robot.

Il a été constaté une forte variabilité des mouvements de démonstration avec les enfants autistes. Dans ce cas, le réseau a besoin de plus de neurones pour apprendre : le nombre de neurones computationnels pour apprendre augmente avec les autistes.

L’expérience avec le robot permet de se dédouaner d’un effet modificateur involontaire induit par un expérimentateur humain.

Robotique sociale et personnes âgées

Anne Sophie Rigaud est Gériatre, chef de service à l’hôpital Broca où un Living Lab a été créé. Cette structure permet l’évaluation des technologies en groupe ou individuellement et de définir les apports de services complémentaires pour les personnes âgées souffrant de troubles cognitifs.

L’étude des besoins chez les personnes souffrantes a mis en évidence l’intérêt pour la stimulation cognitive, le rappel de rendez-vous, l’aide pour retrouver des objets ou le suivi de thérapie. Pour les aidants et les proches, c’est la demande de surveillance et de protection des souffrants qui est prioritaire. Une complexité supplémentaire pour le développement de cette technologie est donc mise en évidence : les demandes entre le patient et les aidants divergent. L’équipe de recherche a également travaillé à l’étude de l’acceptation des robots.

[…] L’article dans son intégralité est paru dans Planète Robots n°52 du 1er juillet 2018